風雨飄搖中的Meta,于昨天發布了一篇重量級論文,提出了一種被稱作「早期經驗」(Early Experience)的全新范式,讓AI智能體「無師自通」,為突破強化學習瓶頸提供了一種新思路。

Meta自從Alexandr Wang加入后混亂不堪,人心惶惶,Yann LeCun也公開表達出走意愿。

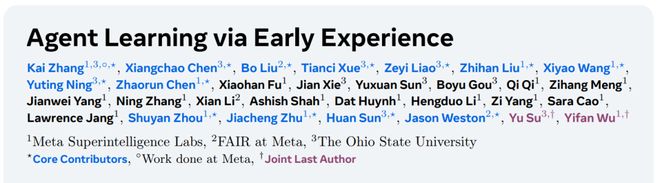

但就在昨天,他們發了一篇大論文《Agent Learning via Early Experience》,提出了一種被稱作「早期經驗」(Early Experience)的全新范式,讓AI智能體「無師自通」,為突破強化學習瓶頸提供了一種新思路。

https://arxiv.org/abs/2510.08558

論文作者絕大多數都是華人。默默做事的,永遠是華人。

研究背景與問題

在現實場景中訓練語言智能體常常面臨一個兩難困境:

強化學習需要明確的環境獎勵信號,但許多真實環境缺乏可驗證的獎勵反饋,或者任務跨度很長導致信用分配(credit assignment)困難;

而模仿學習(通常采取監督微調)則依賴昂貴且有限的專家演示數據,模型在訓練中無法與環境交互,因而難以從失敗中學習,遇到新情況時泛化能力差。

要么沒有獎勵信號指導學習,要么只有少量人類示范可供模仿,智能體的自主成長因此受限。

目前大多數語言智能體采取監督微調的范式:在靜態的專家軌跡數據上訓練策略,將環境狀態映射到人類給定的動作序列。

這種方法雖然訓練方便,卻存在明顯局限:智能體訓練時不與環境互動,看不到自己動作導致的結果,無法「知錯就改」,也很難推廣到訓練數據覆蓋不到的新情境。

此外,高質量專家示范數據獲取成本高昂,難以大規模擴充。

另一方面,理想情況下我們希望讓智能體像人一樣通過自身經驗不斷成長,但是傳統強化學習在缺少獎勵的環境中難以奏效。

面對缺乏獎勵信號且示范數據有限的困境,我們亟需新的訓練范式來讓智能體完成自主學習。