一個大模型持續寫代碼,能寫多久?一小時?一天?還是像大部分AI編程工具那樣,完成一個任務就結束對話?Cursor的CEO MichaelTruell決定搞一次極限壓力測試!

Michael Truell讓Cursor中的GPT-5.2連續運行了整整一周。

不是一小時,不是一天,而是不眠不休,晝夜不停,168小時持續寫代碼。

結果?

300萬行代碼。數千個文件。

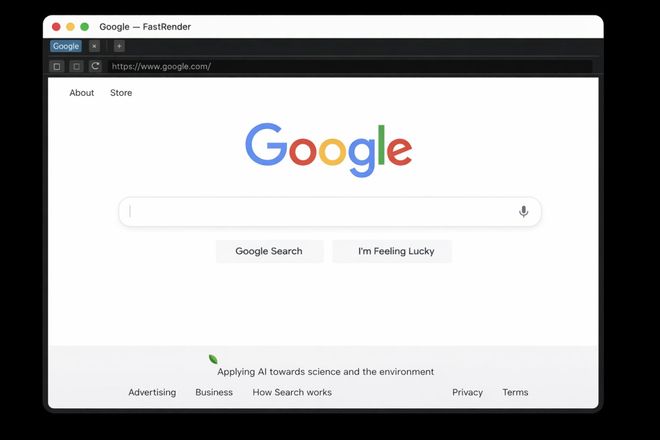

AI完全從零構建出一個全新瀏覽器。

而且,還是Chrome那種瀏覽器。

HTML解析、CSS布局、文本渲染、還有一個自研的JavaScript虛擬機——全是AI自己寫的。

Michael Truell輕描淡寫地發了條推文:它基本能跑!簡單的網頁能快速且正確地渲染出來。

一個模型究竟能跑多久

傳統的AI編程工具,比如Github Copilot和早期的其他IDE,都是一問一答模式。

對話長度有限,上下文有限,任務復雜度有限。

后來出現了所謂的Agentic編程——Claude Code、Cursor Agent、Windsurf等工具讓AI可以自主執行多步任務,讀取文件、運行命令、修復錯誤。

這已經是很大的進步,但大多數情況下,任務仍然以分鐘計算,最多幾小時。

AI完成一個功能,人類review,然后繼續下一個任務。

但沒有人嘗試過讓一個模型連續跑一周。

直到GPT-5.2。

Cursor團隊讓GPT-5.2持續運行了整整一周,不是斷斷續續,而是連續工作。

在這一周里,它:

-

寫下了超過300萬行代碼

-

創建了數千個文件

-

執行了數萬億個token

-

從零構建了一個完整的瀏覽器渲染引擎

一個模型究竟能運行多久?

答案是:理論上,可以無限。

只要基礎設施穩定,只要任務足夠明確,AI就能持續工作——不眠不休,不吃不喝,7×24小時全年無休。

就像澳洲的放羊大叔的「賽博黑工」。

但實際上,不同模型的「耐力」差異巨大。

上下文窗口是第一道門檻。

早期的GPT-3.5只有4K token上下文,意味著對話稍長就會失憶。

Claude 3推出了200K上下文,GPT-4 Turbo跟進128K,Gemini 1.5 Pro更是號稱支持100萬token。

但上下文長度只是理論值——真正考驗的是模型在長任務中能否保持一致性、專注度和執行力。

Cursor團隊在實驗中發現了關鍵差異。